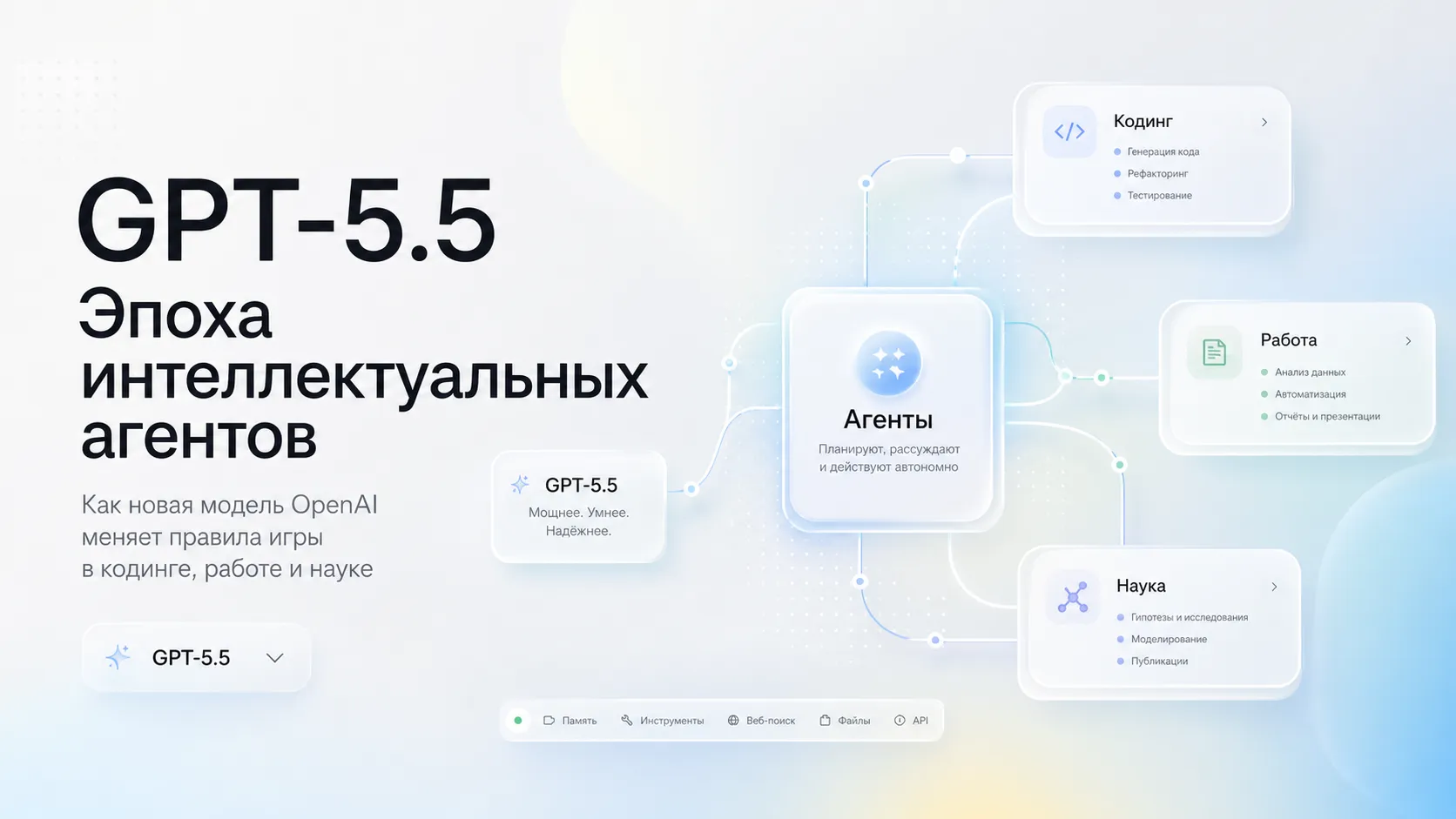

23 апреля 2026 года OpenAI без громких анонсов и предварительных тизеров выпустила GPT-5.5 — модель, которая, по заявлению компании, представляет собой «новый класс интеллекта для реальной работы». Кодовое имя «Spud» (в переводе с английского — «картофелина») не должно вводить в заблуждение: это первый с момента неудачного GPT-4.5 полностью переобученный фундаментальный трансформер, а не очередной файнтюнинг в линейке GPT-5.x. Релиз GPT-5.5 знаменует стратегический разворот — от чат-ботов к автономным агентам, способным самостоятельно планировать, использовать инструменты и доводить многоэтапные задачи до конца. Разбираемся, что именно изменилось и почему это касается не только разработчиков.

Новый фундамент: что скрывается за кодовым именем Spud

Ключевое архитектурное отличие GPT-5.5 от предшественников скрыто не в масштабе, а в подходе к обучению. Начиная с GPT-5.0 и вплоть до 5.4 включительно, все модели представляли собой итеративные доработки на единой предобученной основе — углублялось мышление, интегрировался Codex, добавлялся computer use, но базовый «движок» оставался неизменным. GPT-5.5 ломает эту традицию: это первая модель, прошедшая полный цикл предобучения с нуля после GPT-4.5.

Результат — качественно иная архитектурная «глубина». Модель получила нативную мультимодальность: текст, изображения, аудио и видео обрабатываются в едином потоке, без конвейерной склейки отдельных компонентов, что практически устраняет потери информации при передаче данных между модальностями. Контекстное окно расширено до впечатляющих 1 050 000 токенов, а максимальная длина вывода достигает 128 000 токенов.

Отдельного упоминания заслуживает токен-эффективность. OpenAI официально заявляет: GPT-5.5 сохраняет задержку на уровне GPT-5.4, но при этом потребляет значительно меньше токенов на выполнение идентичных задач. Практические замеры независимых разработчиков фиксируют экономию в диапазоне 20–30%, что частично компенсирует двукратный рост цены за токен. Иными словами, модель стала дороже в пересчёте на тысячу токенов, но дешевле — в пересчёте на решённую задачу.

Бенчмарки: jagged frontier в действии

Производительность GPT-5.5 на стандартизированных тестах формирует классический «рваный фронтир» (jagged frontier), о котором писал профессор Итан Моллик: модель доминирует в одних дисциплинах и уступает конкурентам в других.

На ключевом для OpenAI бенчмарке Terminal-Bench 2.0, оценивающем сложные командные рабочие процессы с планированием и инструментальной координацией, GPT-5.5 набирает 82.7% — против 75.1% у GPT-5.4, 69.4% у Claude Opus 4.7 и 68.5% у Gemini 3.1 Pro. Разрыв с ближайшим конкурентом Anthropic составляет 13.3 процентных пункта — безусловное лидерство.

Схожая картина на GDPval — бенчмарке, охватывающем 44 реальные профессии в области знаний: 84.9% у GPT-5.5 против 80.3% у Opus 4.7. На тесте компьютерного использования OSWorld-Verified модель получает 78.7%, опережая Opus 4.7 (78.0%) и значительно превосходя GPT-5.4 (75.0%). Впечатляет рывок в задачах долгосрочного контекстного поиска: на MRCR v2 GPT-5.5 показывает 74.0%, тогда как GPT-5.4 имел лишь 36.6%, а Opus 4.7 — 32.2%.

Однако на SWE-Bench Pro — индустриальном стандарте для оценки способности моделей решать реальные GitHub-задачи — расклад иной: GPT-5.5 набирает 58.6%, уступая Claude Opus 4.7 с результатом 64.3%. Любопытно, что OpenAI намеренно не включила этот показатель в основные презентационные материалы, что вызвало критику со стороны сообщества.

На FrontierMath GPT-5.5 демонстрирует значительный прогресс: 51.7% на задачах Tier 1–3 (против 43.8% у Opus 4.7) и 35.4% на задачах Tier 4 (против 22.9% у Opus 4.7). Это почти двукратное преимущество в наиболее сложной математической категории.

Приведённые цифры недвусмысленно указывают на специализацию: GPT-5.5 оптимизирован для длинных, многоэтапных, инструментально насыщенных рабочих процессов — и именно в этом качестве его следует оценивать.

Agentic Coding: от автодополнения к автономной разработке

Центральная метафора релиза — «агентная модель кодинга, а не чат-бот». GPT-5.5 позиционируется как интеллектуальный движок, способный самостоятельно писать код, отлаживать его, проводить ревью и даже деплоить — без пошагового контроля со стороны разработчика.

Практические испытания подтверждают амбициозные заявления. CEO MagicPath Пьетро Скирано удалось с помощью GPT-5.5 объединить ветку с сотнями изменений фронтенда и рефакторинга в основную ветку — задача, занявшая 20 минут и потребовавшая единственной итерации: «Я действительно чувствовал, что работаю с высшим интеллектом», — отметил он. Системы CodeRabbit, Cursor и Windsurf независимо зафиксировали улучшения в выполнении длительных задач и обработке неоднозначных инструкций по сравнению с GPT-5.4.

Примечательный пример из внутренней практики OpenAI: финансовая команда использовала GPT-5.5 для проверки 24 771 налоговой формы K-1 общим объёмом 71 637 страниц и завершила аудит на две недели раньше, чем годом ранее. Руководитель Every Дэн Шиппер охарактеризовал модель как «первую модель кодинга, которую я использовал и которая обладает серьёзной концептуальной ясностью».

Ключевое преимущество агентного подхода — не столько способность генерировать код (это умели и предшественники), сколько умение удерживать контекст на длинной дистанции, не «сбиваясь с курса» и самостоятельно корректируя ошибки без вмешательства человека.

Codex как главная сцена: почему модель — лишь половина продукта

Релиз GPT-5.5 невозможно рассматривать в отрыве от параллельного обновления Codex. В день запуска модели десктопная версия Codex получила браузерное управление, обработку Sheets, Slides и Docs, системный голосовой ввод и функцию автоматического ревью кода. По сути, OpenAI синхронно обновила все три уровня своего продуктового стека: модели, приложения и интеграционные шины (харнесы).

Внутри компании свыше 85% сотрудников еженедельно используют Codex в рабочих процессах. Ключевой стратегический ход — открытие подписки Codex для использования в любых сторонних инструментах, включая JetBrains, Xcode, Pi и даже Claude Code. Директор по опыту разработчиков OpenAI Ромен Юэ сформулировал это прямо: «Мы хотим, чтобы люди могли использовать Codex и свою подписку там, где они уже работают».

Ценообразование: дороже вдвое, но дешевле на задачу

API-цены GPT-5.5 составляют $5.00 за миллион входных токенов и $30.00 за миллион выходных — ровно вдвое выше, чем у GPT-5.4 ($2.50/$15.00). Версия Pro обходится в $30.00 за вход и $180.00 за выход.

На первый взгляд — радикальное подорожание. Однако CEO OpenAI Сэм Альтман сопроводил анонс характерным комментарием: «Помните: на каждую задачу вам потребуется меньше токенов, чем с GPT-5.4». Президент компании Грег Брокман добавил, что речь идёт о «новом классе интеллекта», а не просто об очередной точке на кривой «цена-качество».

Для разных сценариев использования доступны гибкие тарифы:

- Batch API — половинная стоимость при обработке в течение 24 часов: $2.50/$15.00 за миллион токенов, что полностью нивелирует удорожание по сравнению с GPT-5.4;

- Flex-обработка — также 50% скидка, но с переменной задержкой от нескольких секунд до минут;

- Priority-обработка — 2.5-кратная наценка за минимальную задержку и повышенные лимиты;

- Промпты длиннее 272K токенов тарифицируются с двукратным коэффициентом на вход и полуторакратным — на выход.

Сравнение с конкурентами подчёркивает рыночную логику: базовая версия GPT-5.5 стоит как Opus 4.7 на входе ($5.00), но дороже на выходе ($30 против $25). Версия Pro — примерно в 7 раз дороже Opus 4.7 по выходным токенам.

Практический эффект, по оценкам OpenAI, — рост чистой интеллектуальной отдачи примерно на 20% с учётом токен-эффективности. Иными словами, каждая задача в среднем обходится лишь немногим дороже, чем на GPT-5.4, при значительно более высоком качестве результата.

Меры безопасности: био- и киберриски под прицелом

GPT-5.5 — первая модель OpenAI, классифицированная по Preparedness Framework как имеющая «высокий» уровень риска в категориях биологической и кибербезопасности. Это потребовало беспрецедентных мер предосторожности.

Модель прошла расширенное тестирование с участием внутренних и внешних команд красных хакеров, специализированные проверки на продвинутые кибер- и биоугрозы, а также сбор обратной связи от почти 200 доверенных партнёров в реальных условиях эксплуатации. Именно соображения безопасности стали причиной задержки API-доступа: веб-интерфейс ChatGPT и Codex получили модель в день релиза, тогда как API был открыт лишь 24 апреля — с отдельным набором защитных механизмов, отличающихся от пользовательских.

Показательна деталь: при запуске GPT-5.5 на внутренней платформе Codex произошла непреднамеренная утечка, в результате которой ограниченному числу Pro-пользователей временно открылся доступ к списку внутренних тестовых моделей, включая GPT-5.5, oai-2.1, Arcanine, Glacier и Heisenberg. Инцидент был устранён в течение нескольких минут, но успел породить волну спекуляций о том, что под кодовыми именами могут скрываться модели на архитектуре, превосходящей Transformer.

API и практика: как работать с GPT-5.5

С точки зрения разработчика, миграция на GPT-5.5 требует пересмотра промпт-стратегии. Модель оптимизирована под «результатно-ориентированные» промпты: вместо пошаговых инструкций рекомендуется описывать желаемый исход, критерии успеха, ограничения и доступные данные, предоставляя модели свободу в выборе пути решения.

Два новых параметра заслуживают особого внимания:

reasoning_effort— управляет глубиной предответного обдумывания. Доступны уровни: none (самый быстрый),low,medium(по умолчанию),high,xhigh. Высокие значения уместны для сложной отладки и архитектурных решений, низкие — для классификации и рутинных операций.text.verbosity—lowдля компактных ответов,mediumдля сбалансированных,highдля развёрнутых объяснений.

Практический пример настройки для быстрой классификации кода:

from openai import OpenAI

client = OpenAI()

response = client.responses.create(

model="gpt-5.5-nano",

input="Этот фрагмент кода — исправление ошибки или новая функциональность?\n\n" + code_diff,

verbosity="low",

reasoning={"effort": "low"}

)Для сложной отладки параметры меняются на противоположные:

response = client.responses.create(

model="gpt-5.5",

input="Этот Flask-сервер периодически возвращает 500 при одновременных запросах (больше 100). Помоги найти причину.",

verbosity="high",

reasoning={"effort": "high"},

tools=[

{"type": "code_interpreter"},

{"type": "function", "function": {"name": "read_file", "description": "Чтение файла проекта", "parameters": {...}}}

]

)Важный нюанс: старые промпты, написанные для GPT-5.x, часто показывают сниженную эффективность на GPT-5.5. Модель ожидает чёткого описания результата, а не детального алгоритма его достижения — и это, пожалуй, главный сдвиг в промпт-инжиниринге, который необходимо освоить разработчикам.

Ограничения и критика

Несмотря на впечатляющие показатели, у GPT-5.5 есть и уязвимости. Показатель галлюцинаций на тесте AA-Omniscience составляет 86% — лишь незначительное улучшение по сравнению с 89% у GPT-5.4, и радикально хуже, чем 36% у Claude Opus 4.7. Модель по-прежнему склонна выдавать уверенные, но фактически неверные утверждения в ситуациях, требующих точных знаний.

На задачах, требующих хирургической точности в исправлении кода (SWE-Bench Pro), GPT-5.5 уступает Opus 4.7, что особенно важно для CI/CD-пайплайнов с автоматическим исправлением дефектов.

Кроме того, базовая версия модели не поддерживает аудио и видео на входе — модальности, в которых конкуренты (в частности, Gemini 3.1 Pro) уже имеют определённые преимущества. Аудиовход остаётся недоступным, а видеовход не поддерживается вовсе, что ограничивает применение модели в сценариях, требующих анализа медиафайлов в реальном времени.

Наконец, ценовой барьер для Pro-версии ($30/$180 за миллион токенов) оставляет этот уровень производительности доступным лишь для крупных Enterprise-заказчиков — индивидуальные разработчики и небольшие команды, скорее всего, продолжат использовать базовую версию.

Перспективы и влияние на рынок

Релиз GPT-5.5 уже спровоцировал волну ответных действий. Anthropic в экстренном порядке исправила «проблему снижения интеллекта» у Claude Opus 4.7, а аналитические агентства зафиксировали резкий рост инвестиций в агентные рабочие процессы на базе Codex. Косвенным подтверждением стратегической важности релиза служит первая за долгое время публикация сравнительных бенчмарков против Opus 4.7 и Gemini 3.1 Pro в официальных материалах OpenAI — компания, традиционно избегавшая прямых сравнений, теперь активно подчёркивает своё лидерство.

Главный вывод для рынка: конкуренция смещается из плоскости «кто умнее в чате» в плоскость «кто эффективнее в автономной работе с инструментами». И GPT-5.5 — это не просто новая модель, а архитектурный манифест, фиксирующий этот тектонический сдвиг.