Современный ландшафт ботостроения немыслим без искусственного интеллекта. Telegram, располагая одной из наиболее развитых экосистем для разработчиков, предлагает официальный HTTP-интерфейс — Telegram Bot API — который позволяет связать любую AI-модель с многомиллионной аудиторией мессенджера. Однако полноценная интеграция интеллектуальных алгоритмов — это не просто склеивание двух API, а продуманная архитектура, опирающаяся на штатные механизмы обновлений, управления состоянием и нативные методы стриминга. В этом материале мы разберём, как использовать официальные возможности Bot API для построения умных, контекстных и быстрых AI-собеседников.

Фундамент: Bot API, BotFather и модель обновлений

Любой Telegram-бот начинается с регистрации у @BotFather — официального инструмента для создания ботов и управления ими. Процесс предельно прост: команда /newbot, выбор имени и получение токена доступа. Этот токен — единственный обязательный ключ, который потребуется для всех дальнейших взаимодействий с Bot API. Важно помнить, что токен необходимо хранить в секрете: скомпрометированный ключ позволяет управлять ботом посторонним лицам.

Для получения сообщений от пользователей Bot API предлагает два взаимоисключающих механизма: Long Polling и Webhook.

- Long Polling подразумевает, что ваш сервер периодически опрашивает Telegram на предмет новых событий с помощью метода

getUpdates. Этот подход идеален для локальной разработки, отладки или сред, где невозможно обеспечить публичный HTTPS-эндпоинт. В продакшен-окружении обычно задают таймаут до 60 секунд, чтобы минимизировать задержки. - Webhook — это механизм, при котором Telegram сам отправляет HTTPS POST-запросы с JSON-сериализованными объектами Update на указанный разработчиком URL мгновенно при поступлении события. Webhook настоятельно рекомендуется для продакшен-сред, так как он обеспечивает минимальную задержку, меньшую нагрузку на серверы Telegram и лучшую масштабируемость. Для дополнительной безопасности можно задать secret_token, который будет передаваться в заголовке

X-Telegram-Bot-Api-Secret-Tokenкаждого запроса

Выбор между Long Polling и Webhook — первое архитектурное решение, которое напрямую влияет на отзывчивость будущего AI-бота.

Интеграция AI: от нативного запроса к продвинутому конвейеру

После настройки приёма сообщений встаёт вопрос об интеграции с AI-провайдером. Принципиальная схема выглядит так: входящий Update извлекает текст сообщения пользователя, отправляется как промпт к языковой модели (OpenAI, Anthropic, Google Gemini, локальная LLM), после чего ответ модели возвращается пользователю через метод sendMessage. На практике всё несколько сложнее. При работе с большими языковыми моделями (LLM) критически важны следующие аспекты:

- Управление контекстом диалога. Каждый вызов LLM без памяти порождает диалог с чистого листа. Для того чтобы бот «помнил», о чём шла речь ранее, необходимо сохранять историю сообщений (как правило, последние 10–20 реплик в виде кольцевого буфера) и отправлять её вместе с новым запросом. В правильно спроектированных системах контекст хранится в оперативной памяти (например, в Redis) для быстрого доступа, а долгосрочная память — в PostgreSQL. Такая архитектура позволяет пользователю вести осмысленный диалог, не повторяя вводные данные.

- Расширенные возможности — Function Calling. Современные LLM поддерживают механизм вызова инструментов (function calling), который позволяет модели не просто генерировать текст, но и взаимодействовать с внешними сервисами: выполнять поиск в интернете, обращаться к API, производить вычисления, отправлять уведомления. В контексте Telegram-ботов это открывает путь к созданию полноценных AI-ассистентов, способных, например, найти актуальную информацию по запросу пользователя и вернуть её в структурированном виде.

- Мультипровайдерность и безопасность ключей. Зрелые AI-боты часто поддерживают несколько AI-провайдеров одновременно (OpenAI, Anthropic Claude, Google Gemini и др.), позволяя пользователю переключаться между моделями через встроенное меню настроек. При этом API-ключи должны храниться в зашифрованном виде, а их управление — осуществляться непосредственно в чате с ботом через команды вроде

/settings.

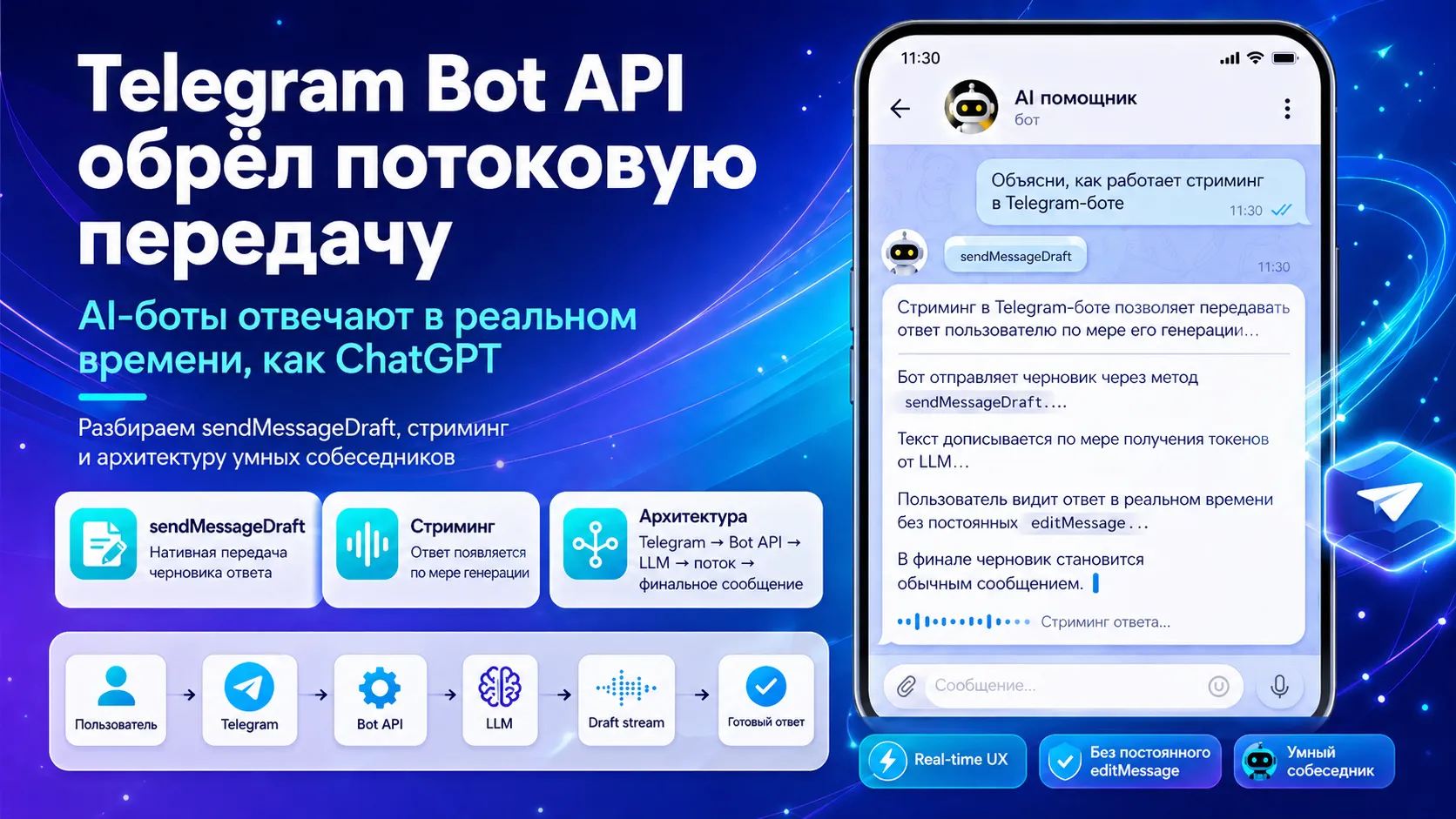

Потоковая передача ответов AI: от «дёрганого» редактирования к нативному стримингу

Одно из главных требований к современному AI-интерфейсу — эффект «печатания» текста в реальном времени (streaming), когда пользователь видит, как ответ генерируется слово за словом. Telegram долгое время не имел для этого нативного метода, и разработчики были вынуждены прибегать к хакам: сначала отправлять пустое сообщение, а затем циклически вызывать editMessageText, обновляя его содержимое по мере генерации токенов. Такой подход имел серьёзные недостатки: заметные задержки между обновлениями (из-за троттлинга во избежание rate limit), риск блокировки при частых запросах, неестественное «дёрганое» обновление текста.

В декабре 2025 года с выходом Bot API 9.3 появился долгожданный метод sendMessageDraft — нативный механизм для потоковой передачи частичных сообщений. Он позволяет разработчикам отправлять фрагменты текста с присвоением уникального draft_id; каждый последующий вызов с тем же идентификатором анимирует изменения в существующем «черновике». Когда генерация завершена, итоговое сообщение финализируется обычным вызовом sendMessage.

Следующим эволюционным шагом стал Bot API 9.5 (март 2026 года), который снял последние ограничения: если раньше sendMessageDraft работал только в приватных чатах с поддержкой форумных тем, то теперь стриминг доступен во всех типах чатов — приватных, группах и супергруппах. Пользовательский опыт при этом кардинально меняется: бот показывает индикатор набора текста («печатает...»), а ответ плавно появляется на экране точно так же, как в ChatGPT или Claude.

Практический пример стриминга с использованием grammY:

import { Bot, Context } from "grammy";

import { autoRetry } from "@grammyjs/auto-retry";

import { stream, StreamFlavor } from "@grammyjs/stream";

type MyContext = StreamFlavor<Context>;

const bot = new Bot<MyContext>("YOUR_BOT_TOKEN");

bot.api.config.use(autoRetry());

bot.use(stream());

bot.chatType("private").command("stream", async (ctx) => {

async function* llmStream() {

yield "Анализирую запрос...";

await sleep(500);

yield " Формирую ответ: ";

await sleep(300);

yield "это пример потоковой";

await sleep(200);

yield " передачи текста в Telegram.";

}

await ctx.replyWithStream(llmStream());

});

bot.start();Данный код использует плагин @grammyjs/stream, который автоматически управляет draft_id и вызывает sendMessageDraft для каждого порождаемого фрагмента текста, финализируя сообщение после завершения итерации.

Бизнес-режим и AI-ассистенты для предпринимателей

Особого внимания заслуживает Telegram Business — функция, позволяющая бизнес-пользователям подключать ботов для автоматической обработки входящих сообщений от их имени. Это открывает прямой путь к созданию AI-ассистентов, которые не просто отвечают в отдельном чате, а интегрированы в рабочий процесс компании: отвечают клиентам, обрабатывают запросы, интегрируются с CRM-системами и внутренними инструментами. Разработчикам достаточно включить Business Mode в настройках бота у @BotFather, чтобы бот мог получать соответствующие обновления и взаимодействовать с бизнес-аккаунтами.

Telegram Mini Apps: когда текстового интерфейса недостаточно

Для сценариев, где требуется более богатый пользовательский интерфейс, Telegram предлагает Mini Apps — полноценные веб-приложения на JavaScript, запускаемые прямо внутри мессенджера. Mini Apps могут использовать собственные SDK для доступа к цветовой схеме Telegram, вибрации, облачному хранилищу и другим нативным возможностям. Это делает их идеальной платформой для AI-интерфейсов с расширенной функциональностью: дашбордами аналитики, формами настройки модели, визуализацией данных, выбором между несколькими LLM. Например, mini-приложение может предоставлять интерфейс для общения с Claude 3.7 Sonnet, поддерживать переключение между диалогами и детальную настройку параметров модели, оставаясь в рамках экосистемы Telegram.

Архитектура для продакшена: безопасность, мониторинг и отказоустойчивость

При развёртывании AI-бота в продакшен-среде необходимо учитывать ряд архитектурных аспектов:

- Валидация webhook-запросов. Всегда проверяйте заголовок

X-Telegram-Bot-Api-Secret-Tokenдля подтверждения подлинности входящих запросов от Telegram. - Очереди и воркеры. Использование очередей с настраиваемым размером и пула асинхронных воркеров позволяет обрабатывать пиковые нагрузки без потери обновлений и гарантировать, что Telegram получит ответ в рамках установленного таймаута.

- Мониторинг. Внедряйте health-эндпоинты (например,

/health/telegram-webhook) для отслеживания состояния очереди, количества активных воркеров и общей работоспособности webhook-интеграции. - Rate limiting. Учитывайте лимиты Telegram (до 30 сообщений в секунду для обычных ботов) и используйте плагины автоматического повтора запросов (такие как

auto-retryдля grammY) для обработки ошибок 429. - Безопасность AI-ключей. Никогда не храните API-ключи к AI-провайдерам в открытом виде в коде или репозитории — используйте переменные окружения и шифрование.

Заключение

Telegram Bot API прошёл стремительную эволюцию от простого интерфейса отправки сообщений до полноценной платформы для создания интеллектуальных диалоговых систем. Нативная поддержка реакций (Bot API 7.0), система ответов 2.0 с цитированием, бизнес-режим, Mini Apps и, наконец, полноценный стриминг через sendMessageDraft (API 9.3 и 9.5) — всё это образует фундамент, на котором можно строить AI-ботов, сопоставимых по пользовательскому опыту с лучшими чат-интерфейсами. Ключ к успеху — грамотная архитектура, сочетающая надёжный приём обновлений (webhook), управление контекстом диалога, интеграцию с AI-провайдерами и эффективную потоковую доставку ответов. Используя официальные механизмы платформы, разработчик получает не только широкие технические возможности, но и гарантию стабильности и обратной совместимости, что критически важно для долгосрочных проектов.