Эпоха, когда веб-сайт представлял собой статичный набор страниц, созданный один раз и редко изменяемый, окончательно завершилась. К 2026 году искусственный интеллект прошел путь от вспомогательного инструмента до центрального элемента всей экосистемы веб-разработки: он проектирует интерфейсы, генерирует и оптимизирует код, персонализирует контент для каждого посетителя и управляет поисковым продвижением. Эта трансформация носит не косметический, а фундаментальный характер: меняется сама архитектура сайтов, роль разработчиков и дизайнеров, а также пользовательский опыт. По данным отчета Belitsoft, в 2026 году 42% всего коммит-кода создается искусственным интеллектом, и эта доля, по прогнозам, достигнет 65% к 2027 году. Рынок генеративного ИИ в разработке программного обеспечения вырос с $66,29 млрд в 2025 году до $82,54 млрд в 2026 году, демонстрируя совокупный годовой темп роста на уровне 24,5%. В этой статье мы детально рассмотрим, как именно AI меняет процесс создания и функционирования сайтов, какие технологии лежат в основе этих изменений, и какие последствия это имеет для бизнеса и конечных пользователей.

Фундаментальный сдвиг: от генерации кода к агентным системам

Еще в 2024 году основные дискуссии велись вокруг того, может ли AI генерировать осмысленный HTML/CSS-код. Сегодня этот вопрос потерял актуальность. Согласно систематическому обзору 46 рецензируемых исследований, проведенному по методологии PRISMA, количество работ, посвященных AI-ассистированной веб-разработке, ежегодно росло в среднем на 80% в период с 2020 по 2025 год, а исследования сконцентрировались вокруг пяти ключевых направлений: автоматическая генерация кода, AI-ассистированный дизайн UI/UX, интеллектуальная веб-оптимизация, естественно-языковые интерфейсы и AI-поддерживаемое тестирование.

Однако наиболее значимый качественный скачок 2025-2026 годов заключается не в объеме генерируемого кода, а в переходе от простых «AI-писателей кода» к агентным системам, способным автономно управлять веб-ресурсом. Платформа Vercel, позиционирующая себя как «AI Cloud», предоставляет унифицированную среду для создания, развертывания и масштабирования AI-приложений, включая агентные рабочие нагрузки и конвейерные интерфейсы. Ключевым компонентом этой экосистемы является Vercel AI SDK, который позволяет интегрировать языковые модели с потоковой передачей данных и вызовом инструментов, а также AI Gateway, маршрутизирующий запросы к различным AI-провайдерам с автоматическим переключением при сбоях.

Показательным примером агентного подхода служит v0 — AI-агент от Vercel, способный по текстовому описанию создавать полноценные приложения и даже целые веб-сайты. В отличие от инструментов, генерирующих статичные макеты, v0 создает как фронтенд, так и бэкенд-логику, используя современный стек (Next.js, Tailwind, shadcn/ui), подключается к API и базам данных, и позволяет развернуть результат в продакшен одним кликом. Важно, что такие агенты обладают способностью к автономному поиску в интернете, инспекции сайтов, исправлению ошибок и интеграции с внешними инструментами.

Архитектурная революция: серверные компоненты и Rust-инструментарий

Внедрение AI в веб-разработку совпало с тектоническими сдвигами в архитектуре фронтенда. Фреймворк Next.js 16 (App Router), вышедший в октябре 2025 года, сделал React Server Components стандартом по умолчанию. Это позволило сократить объем клиентского JavaScript на 30-50%, а в ряде проектов — более чем на 70%, что напрямую улучшило метрики Core Web Vitals и, следовательно, позиции в поисковой выдаче Google. React Compiler (ранее известный как React Forget) достиг версии 1.0, автоматически выполняя мемоизацию компонентов на этапе сборки — в тестах Belitsoft это дало ускорение начальной загрузки до 12% и повышение скорости взаимодействий в 2,5 раза.

Параллельно произошел переход на Rust-инструментарий сборки. Next.js 16 использует Turbopack в качестве сборщика по умолчанию, что обеспечивает ускорение сборки в 2-5 раз по сравнению с Webpack, а Vite 8, вышедший в марте 2026 года, интегрировал Rolldown — Rust-бандлер, ускоряющий процесс сборки в 10-30 раз.

Эти архитектурные изменения создали идеальную среду для AI-кодинга. Типизированная кодовая база (TypeScript занимает 38% рынка среди профессиональных разработчиков, а 72% вакансий фронтенд-разработчиков требуют его знания) снижает уровень галлюцинаций AI-моделей и повышает точность генерируемого кода. В результате 76,6% организаций уже активно используют AI в процессах разработки, а еще 20,4% находятся на стадии оценки внедрения — лишь 3,1% остаются полностью в стороне от этого тренда.

AI-инструменты для создания сайтов: обзор ключевых игроков 2026 года

Рынок AI-конструкторов сайтов достиг объема в $6,3 млрд в 2026 году и, по прогнозам, вырастет до $31,5 млрд к 2033 году. При этом ландшафт инструментов претерпел кардинальные изменения по сравнению с 2024–2025 годами. Независимое тестирование, проведенное изданием ZDNet в начале 2026 года, показало: если годом ранее ни один AI-конструктор не справлялся с задачей адекватно, то теперь Hostinger и GoDaddy предлагают продукты, на которые можно положиться при создании полноценного сайта.

Ключевые игроки рынка распределяются по нескольким нишам:

- Wix Harmony (запущен в январе 2026 года) представляет гибридную модель, объединяющую «вайб-кодинг» (создание сайта через текстовые промпты) с полноценным визуальным редактором drag-and-drop. В основе лежит AI-агент Aria, понимающий естественный язык и контекст сайта. В отличие от многих инструментов «вайб-кодинга», генерирующих демо-версии с багами и уязвимостями, Harmony обеспечивает продакшен-уровень надежности, безопасности и масштабируемости, включая встроенные инструменты e-commerce, SEO и соответствие GDPR.

- Hostinger AI Website Builder прошел путь от полной неработоспособности до одного из лучших решений рынка. Он использует интервью-подход для определения структуры и фокуса сайта, автоматически подбирает макеты, цвета, шрифты и генерирует текстовый контент. Единственным ограничением остается отсутствие возможности AI-модификации CSS-блоков.

- Taskade Genesis позиционируется как создатель «живых сайтов» — веб-ресурсов, которые не просто генерируются AI при создании, но и продолжают самостоятельно функционировать после запуска: встроенные AI-агенты обрабатывают формы, маршрутизируют посетителей, отвечают на вопросы и запускают автоматизации через 100+ интеграций.

- Отдельно стоит отметить нишевые open-source проекты. Например, Agentic AI Website Builder (Python) конвертирует естественно-языковые промпты в полноценные сайты с фронтендом и бэкендом, используя OpenAI API, и сохраняет результат в виде готовой к использованию структуры папок.

Общая рекомендация независимых тестировщиков: AI-конструкторы хорошо справляются со структурой сайта, но их встроенные возможности text-to-image остаются посредственными — для генерации качественных изображений лучше использовать специализированные инструменты вроде ChatGPT image tool или Google Nano Banana.

Гиперперсонализация: когда сайт изучает посетителя в реальном времени

Одно из наиболее значимых применений AI в вебе — персонализация пользовательского опыта. Традиционные подходы, основанные на правилах («если посетитель вернулся, показать XYZ»), уступают место системам, которые непрерывно обучаются на поведении пользователя и адаптируют контент, верстку и даже цветовую схему в реальном времени.

Наиболее впечатляющий пример практического внедрения — кейс компании Target. Команда Data Science разработала систему, использующую контекстуальные бандиты (алгоритмы класса LinUCB) для динамического управления расположением рекомендательных каруселей на страницах товаров. Каждое взаимодействие пользователя — скролл, клик, поисковый запрос — становится сигналом для обучения модели. По сравнению со статичным базовым вариантом, самообучающаяся система увеличила показатели кликабельности и добавления товаров в корзину и сгенерировала дополнительный спрос, оцененный в $50 млн. Система развернута как низколатентный Python-микросервис, интегрированный через gRPC с автомасштабированием Kubernetes, и достигает задержки инференса p95 менее 25 мс.

На уровне отдельных сайтов аналогичные принципы реализуются через инструменты вроде Cerebras Hyper-Personalization Cookbook. Эта система демонстрирует, как с помощью Pydantic-схем для структурирования ответов LLM и шаблонизатора Jinja2 можно создавать страницы, адаптирующиеся под предпочтения пользователя: цветовую схему (красный, зеленый, белый), тон общения (формальный, дружеский, повседневный), язык (английский, испанский, немецкий) и релевантные продукты — и все это в реальном времени, благодаря сверхбыстрому инференсу Cerebras.

Для владельцев WordPress-сайтов существует плагин Smart Local AI, который выполняет все вычисления непосредственно в браузере посетителя с использованием Transformers.js и WebGPU/WASM. Это обеспечивает полную приватность данных (ничего не передается на внешние серверы) и отсутствие абонентской платы за API. Плагин отслеживает 30 поведенческих сигналов (глубина скролла, время чтения, паттерны кликов) и строит персональный «вектор вкуса» для каждого посетителя, обеспечивая рекомендации контента в стиле Netflix.

Практический эффект от персонализации подтверждается исследованиями: согласно отчету McKinsey, персонализированный маркетинг снижает стоимость привлечения клиентов до 50%, увеличивает выручку на 5-15% и повышает возврат на маркетинговые инвестиции на 10-30%.

AI в SEO: от написания текстов к полной автоматизации поискового продвижения

Влияние AI на поисковую оптимизацию вышло далеко за пределы генерации SEO-текстов. В 2026 году сформировался новый класс инструментов — AI SEO Agents, которые автоматизируют полный цикл поискового продвижения. Исследование, проведенное командой Frase, протестировало 10 ведущих AI SEO-решений по единому критерию: сколько из шести стадий SEO-конвейера (Research, Strategy, Write, Audit, Monitor, Fix) каждый инструмент автоматизирует без вмешательства человека. Результаты показали, что только Frase охватывает все шесть стадий, в то время как Surfer SEO и Semrush автоматизируют по три.

Шестистадийная модель автоматизации SEO включает:

- Исследование — автоматический сбор ключевых слов, анализ поискового намерения, оценка конкурентов.

- Стратегия — формирование контент-плана, приоритезация тем, распределение ресурсов.

- Написание — генерация SEO-оптимизированного контента на основе брифа.

- Аудит — проверка опубликованного контента на соответствие лучшим практикам.

- Мониторинг — отслеживание позиций, трафика, изменения алгоритмов.

- Исправление — автоматическое выявление и корректировка страниц, теряющих позиции.

Важно отметить, что 86% SEO-специалистов уже интегрировали AI в свои рабочие процессы, но большинство по-прежнему комбинируют 3-5 разрозненных инструментов для покрытия полного цикла.

Новым вызовом для SEO в 2026 году стала оптимизация под AI-поисковики. По данным исследований, количество переходов с AI-рефереров выросло на 527% год к году, а 60% поисковых запросов в Google завершаются без единого клика на какой-либо сайт. Инструменты вроде SE Ranking и SE Visible теперь отслеживают не только позиции в традиционной выдаче, но и видимость бренда в ответах AI-поисковиков и генеративных сниппетах.

Кроме того, в 2026 году сформировалась концепция GEO (Generative Engine Optimization) — адаптация контента для того, чтобы большие языковые модели ссылались на него в своих ответах. SerpSling AI позиционируется как оптимизационный движок, создающий контент, «который AI-модели действительно хотят цитировать».

Доступность (Accessibility): AI как инструмент инклюзивности

Автоматизация веб-доступности — одна из областей, где AI демонстрирует наиболее измеримый социальный эффект. С 28 июня 2025 года вступил в силу Европейский акт о доступности (European Accessibility Act), предусматривающий штрафы до €300 000 для компаний, чьи сайты не соответствуют требованиям WCAG 2.1/2.2 . Это сделало accessibility не вопросом доброй воли, а обязательным требованием для бизнеса.

Рынок AI-инструментов accessibility разделился на два лагеря:

- Инструменты source-code remediation (TestParty, axe DevTools) — встраиваются непосредственно в процесс разработки и автоматически исправляют проблемы доступности на уровне исходного кода. TestParty, например, интегрируется через GitHub Actions, Shopify-приложения и pre-deploy gates, реализуя «долговечные изменения на уровне кода».

- Оверлеи — накладывают визуальный слой поверх сайта, маскируя проблемы без изменения кода. Эксперты по accessibility, включая Kanopi Studios, категорически не рекомендуют использовать такие решения, поскольку они «могут конфликтовать с экранными читалками и клавиатурной навигацией... и создают ложное ощущение соответствия требованиям, что уже приводило к судебным искам».

Особое внимание стоит уделить браузерным расширениям, которые делают интернет доступным для людей с ограниченными возможностями. Например, расширение Accessible.ai, созданное на основе open-source, доступно на GitHub. Оно использует встроенную в Chrome модель Gemini Nano для создания мультимодального инструмента, который помогает людям с нарушениями зрения (путем автоматического озвучивания содержимого страницы), дислексией и СДВГ (предлагая альтернативные способы взаимодействия с контентом). Модель функционирует локально на устройстве пользователя, обеспечивая полную конфиденциальность.

Этические аспекты: что поставлено на карту

Массовое внедрение AI в веб-разработку поднимает ряд фундаментальных этических вопросов, которые W3C формализовал в документе «Ethical Principles for Web Machine Learning»:

- Точность (Accuracy): Отклонение от истинного значения может влиять на жизнь людей, включая кредитный скоринг и одобрение займов.

- Предвзятость (Bias): Систематические отклонения могут непропорционально затрагивать отдельные группы людей.

- Приватность (Privacy): Сбор персональных данных для обучения моделей без ведома и согласия пользователей.

На практике ключевые этические риски включают:

- Право собственности и лицензирование AI-сгенерированного кода. Неясно, кому принадлежит код, созданный AI: разработчику, написавшему промпт, компании-владельцу модели или владельцу исходного кода, на котором модель обучалась. Код, сгенерированный AI, может содержать фрагменты из проектов с ограничительными лицензиями (например, GPL), что создает юридические риски для коммерческих продуктов.

- Уязвимости безопасности. AI-модели обучаются на огромных массивах публичного кода, включая код с уязвимостями, и могут воспроизводить проблемы вроде SQL-инъекций, XSS или небезопасного хранения учетных данных.

- Конфиденциальность данных. Если разработчики включают проприетарную информацию или персональные данные (PII) в промпты, эти данные могут быть переданы стороннему AI-провайдеру и использованы для обучения моделей, что потенциально нарушает GDPR и CCPA.

Практические рекомендации включают создание четких политик использования AI-инструментов (запрет на передачу чувствительных данных в промптах), обязательное ревью каждой строки AI-сгенерированного кода, а также использование подхода «human-in-the-loop» для всех AI-выходов — особенно alt-текстов, субтитров и других элементов accessibility.

При этом важно понимать: несмотря на впечатляющий прогресс, AI-инструменты пока не способны заменить senior-разработчиков. Как точно подмечено в исследовании Webix, AI выступает в роли «дополнительной пары рук» для типовых задач (автодополнение кода, генерация скелета тестов, boilerplate), но для креативного решения проблем и работы с высококонтекстными задачами разработчики по-прежнему полагаются исключительно на собственный опыт. Опрос Stack Overflow 2025 года показал, что 82% разработчиков используют ChatGPT и 68% — GitHub Copilot, но лишь 17% AI-сгенерированного кода попадает в продакшен без изменений; остальное подвергается рефакторингу.

Конец эпохи статичного веба

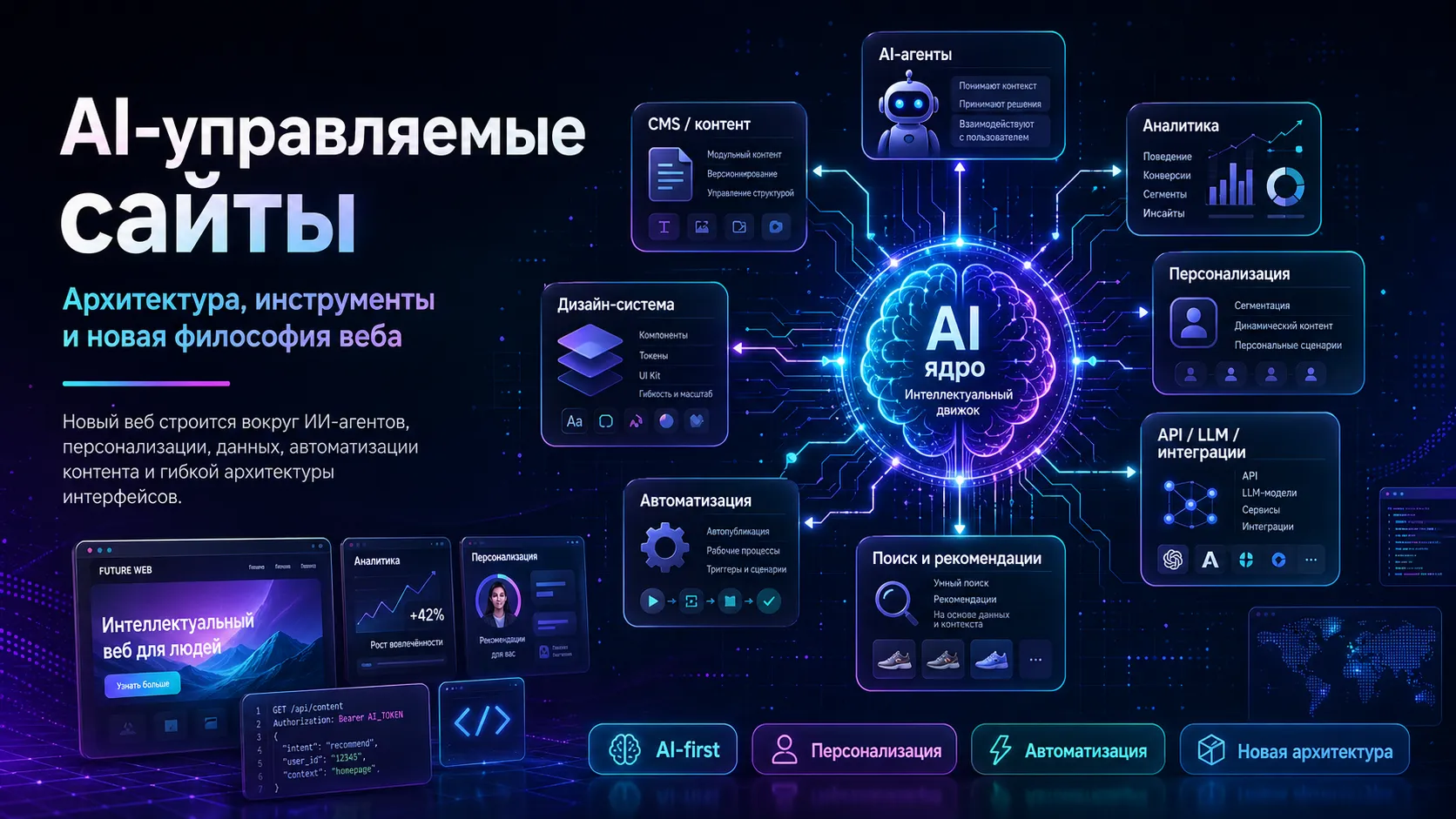

К середине 2026 года можно констатировать, что AI-управляемые сайты — это уже не эксперимент, а мейнстрим. Индустрия прошла путь от AI как генератора HTML-шаблонов до полноценных агентных систем, способных автономно управлять веб-ресурсом: от проектирования интерфейса и написания бэкенд-логики до персонализации контента для каждого посетителя и автоматического SEO-продвижения.

Ключевые тренды, определяющие ландшафт:

- Архитектурный сдвиг: React Server Components и Rust-инструментарий создали техническую базу для AI-native разработки.

- Агентная модель: Сайты превращаются из статичных страниц в «живые системы» со встроенными AI-агентами, продолжающими работать после деплоя.

- Гиперперсонализация: Машинное обучение в реальном времени адаптирует контент, верстку и визуальное оформление под конкретного пользователя, обеспечивая измеримый рост конверсии.

- Этический императив: По мере роста AI-сгенерированного кода критически важными становятся вопросы лицензирования, безопасности и приватности.

Однако центральный вывод, который прослеживается во всех исследованиях и практических кейсах, заключается в том, что AI не заменяет человека, а меняет характер его работы. Дизайнеры и разработчики, освоившие AI-инструменты, получают «сверхспособности» — способность прототипировать в минутах, а не днях, фокусироваться на стратегических и креативных задачах. При этом окончательные решения — о визуальном языке бренда, архитектуре системы, UX-стратегии — остаются за человеком. Как сформулировала команда WPBakery: «Веб 2026 года будет построен машинами, но вдохновлен людьми».